Как автономное оружие будет использоваться в наших вооруженных силах, пока неясно. Пол Шарре рассказывает, почему следует тщательно продумать их будущее использование на поле боя.

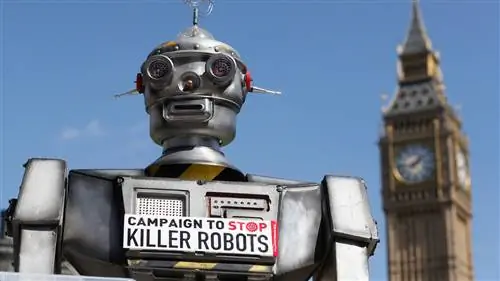

Автономное оружие может стать военной машиной будущего. Однако их использование «поднимает новые вопросы риска», пишет бывший чиновник Пентагона Пол Шарре, поэтому их будущее использование на поле боя должно быть тщательно продумано.

Scharre руководит Инициативой 20YY Future of Warfare в Центре новой американской безопасности (CNAS), группе политических исследований в Вашингтоне, округ Колумбия. В отчете «Автономное оружие и оперативный риск» Шарре обсуждает виды сбоев, которые могут возникнуть, если военные внедрят полностью автономные системы.

Шарр признает, что большая часть наших опасений, связанных с автоматизированными системами, вызвана тем, что мы читали в научно-фантастических романах. По правде говоря, роботизированные системы способны привести к утопическому обществу. Автономные автомобили - прекрасный пример того, как роботы могут создать лучшее будущее.

«Я думаю, что через 100 лет люди оглянутся назад и скажут: «Правда? Люди ездили на своих машинах? Что они, сумасшедшие?» Люди - худшая система управления, которую можно поставить перед автомобилем, », - говорит Питер Х. Диамандис, председатель и главный исполнительный директор Фонд XPRIZE.

Есть две точки зрения, которые формируют дискуссию об автономном оружии: «некоторые [рассматривают] их как потенциально полезные технологии, которые могли бы сделать войну более точной и гуманной, а другие [рассматривают] их как опасные технологии, которые может привести к катастрофе»

Роботизированным системам не хватает гибкости для адаптации к новым возникающим ситуациям. Они делают именно так, как запрограммированы, и им не хватает способности «выходить за рамки своих инструкций и руководствоваться «здравым смыслом»».

“Любой, кто когда-либо был разочарован автоматическим телефоном службы поддержки, будильником, ошибочно установленным на «после полудня» вместо «утра», или любым из бесчисленных разочарований, связанных с взаимодействием с компьютерами., столкнулся с проблемой «хрупкости», от которой страдают автоматизированные системы», - пишет г-н Шарре.

Шарр выступает за то, что он описывает как «Centaur Warfighting» - совместную работу команды человека и машины. Человек будет выступать в роли отказоустойчивый, моральный компас и наблюдатель за работой машины. В то время как робот будет выполнять команды, сделанные человеком, с большей точностью и аккуратностью. «[T]eaming когнитивные архитектуры могут использовать предсказуемость, надежность и скорость автоматизации, сохраняя при этом надежность и гибкость человеческого интеллекта. По возможности предпочтение отдается совместной работе человека и машины».

Такие пары доказали свою эффективность на гораздо менее рискованных стратегических полях сражений. В шахматах объединение человека-эксперта с искусственный интеллект стирает пол с командами, которые используют только искусственный интеллект или людей.

«Искусственный интеллект может анализировать возможные ходы и выявлять уязвимости или возможности, которые игрок-человек мог упустить, что приводит к играм без грубых ошибок», - объясняет Шарре. «Игрок-человек может управлять стратегией, сокращать поиск ИИ, чтобы сосредоточиться на наиболее перспективных областях, и управлять различиями между несколькими ИИ. Шахматный ИИ или несколько ИИ дают обратную связь игроку-человеку, который затем решает, какой ход сделать».

Как автономное оружие будет использоваться в наших вооруженных силах, неясно. Это продолжающаяся дискуссия, но о ней важно знать. Многие из самых ярких умов мира уже высказались и обеспокоены тем, что развитие ИИ опережает нашу способность регулировать это. Технологии следует использовать на благо человечества, а не создавать антиутопию Скайнета. Стивен Хокинг и Илон Маск открыто заявили о своем недоверии к искусственному интеллекту. Даже Бюллетень ученых-атомщиков предупредил, что если прорывные технологические достижения и дальше будут бесконтрольно развиваться, человечество может столкнуться с глобальной катастрофой

Питер Уоррен Сингер, старший научный сотрудник и директор Инициативы обороны 21-го века в Институте Брукингса, взял интервью у ряда экспертов о возможности апокалипсиса роботов. Он обнаружил, что многие из них думали, что это невозможно или это глупая идея. Однако Сингер вспоминает, что сказал ему один ученый из Пентагона; - сказал он.